近日,新型 AI 研发实验室 Answer.AI、英伟达等发布了 ModernBERT。

ModernBERT 项目主要有三个核心点:

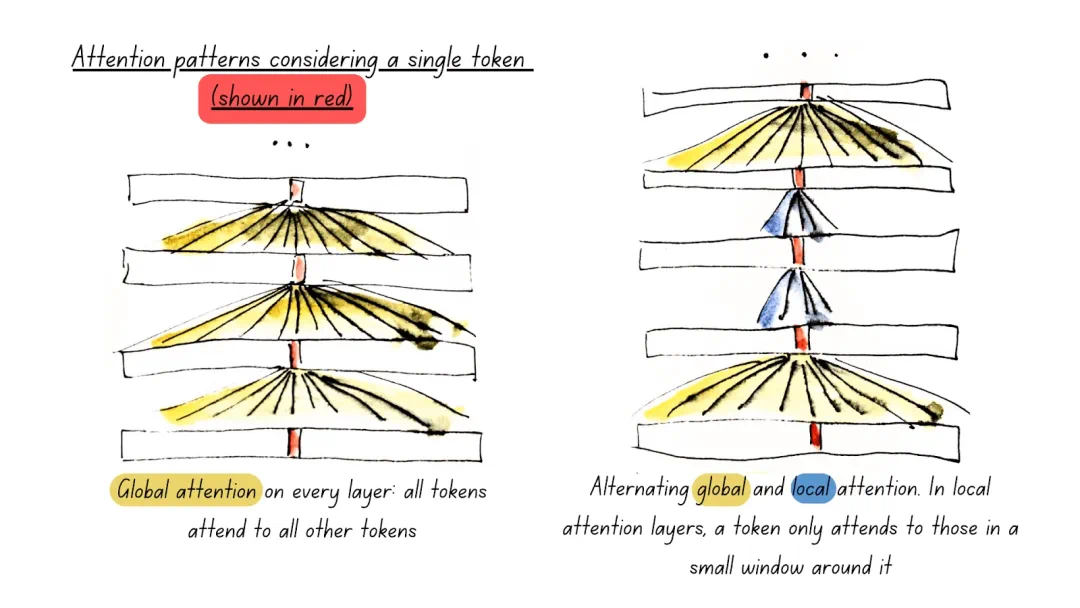

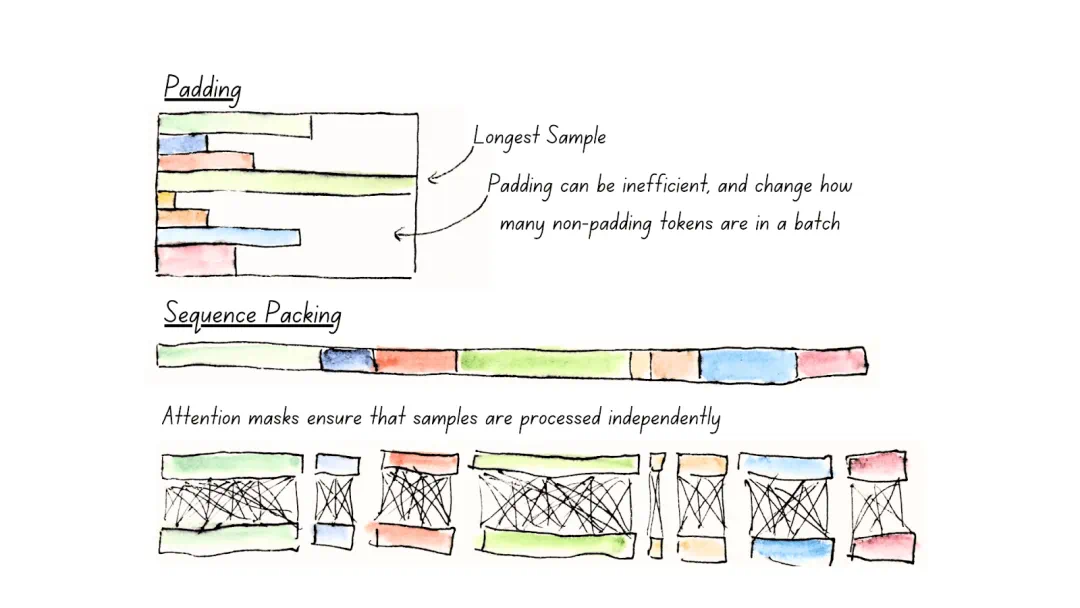

- 现代化的 transformer 架构;

- 特别重视注意力效率;

- 以及数据。

ModernBERT 是一个新的模型系列,具有两个型号:基础版 139M 、较大版 395M。在速度和准确率方面都比 BERT 及其同类模型有了显著改进。该模型采用了近年来在大型语言模型 (LLM) 方面的数十项进展,包括对架构和训练过程的更新。

除了速度更快、准确度更高外,ModernBERT 还将上下文长度增加到 8k 个 token,而大多数编码器只有 512 个 token,并且是第一个在训练数据中包含大量代码的仅编码器专用模型

Answer.AI 联合创始人 Jeremy Howard 表示,ModernBERT 不炒作生成式 AI(GenAI),而是真正的主力模型,可用于检索、分类,是真正有用的工作。此外还更快、更准确、上下文更长、更有用。

ModernBERT 的上下文长度为 8,192 个 token,比大多数现有编码器长 16 倍以上。

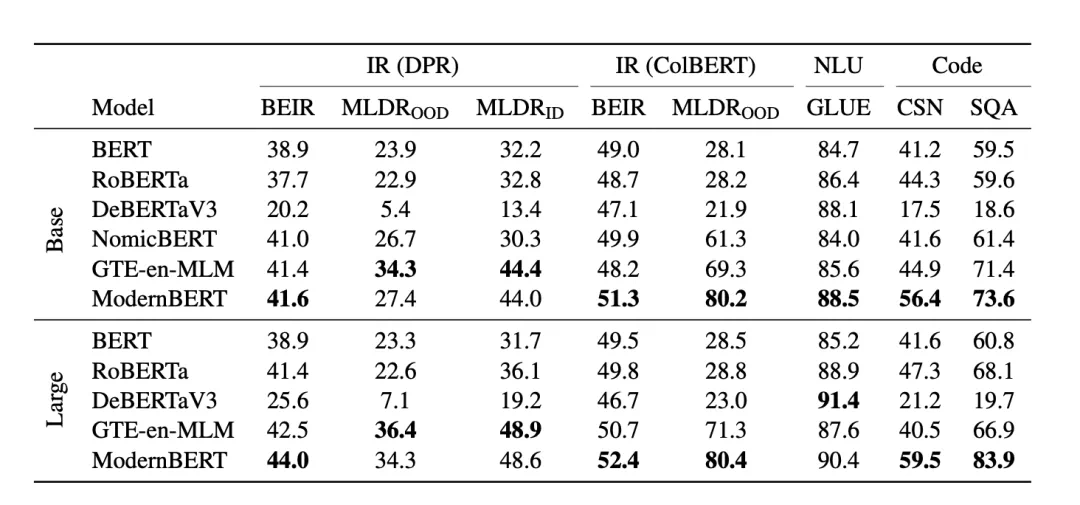

对于代码检索,ModernBERT 的性能是独一无二的,因为之前从未有过编码器模型在大量代码数据上经过训练。例如,在 StackOverflow-QA 数据集 (SQA) 上,这是一个混合了代码和自然语言的混合数据集,ModernBERT 的专业代码理解和长上下文使其成为唯一一个在此任务上得分超过 80 的模型。

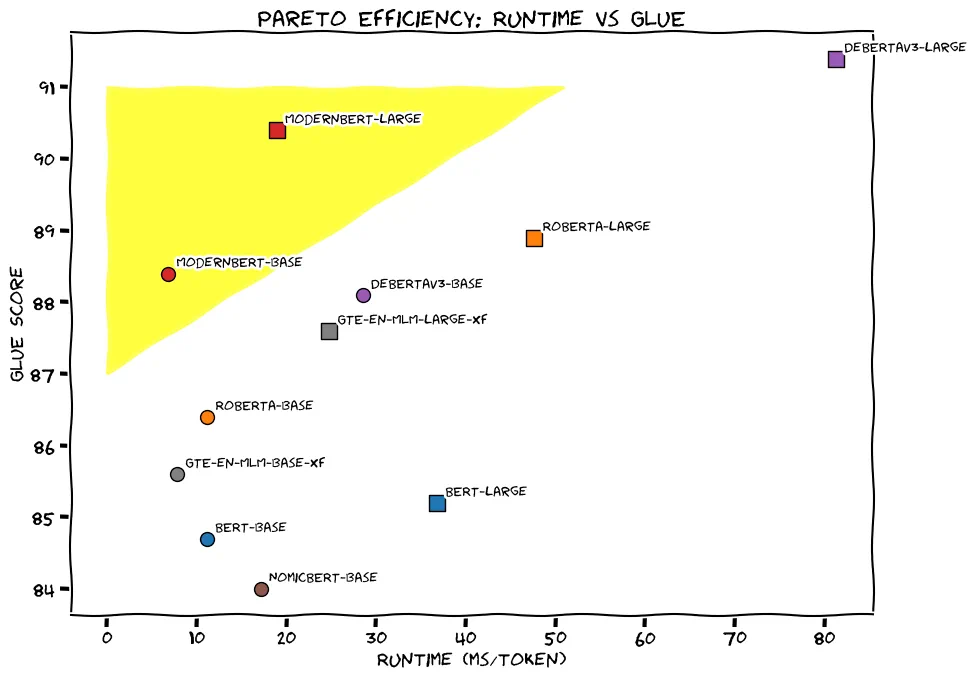

与主流模型相比,ModernBERT 在检索、自然语言理解和代码检索这三大类任务中表现突出。虽然 ModernBERT 在自然语言理解任务上稍微落后于 DeBERTaV3,但其速度要快很多倍。

与特定领域的模型相比,ModernBERT 在大多数任务中都相当或更胜一筹。此外,ModernBERT 在大多数任务中都比大多数模型更快,并且可以处理多达 8,192 个 token 的输入,比主流模型长 16 倍

- 原文地址:huggingface.co

- 论文地址:arxiv.org

- 项目主页:github.com

本期主播:蛋酥酥/猫猫

后期:蛋酥酥

制作人:蛋酥酥

录制支持:KUEENDOM

📻 收听平台:

小宇宙/Apple podcasts

☎️ 联系方式:

空空如也

暂无小宇宙热门评论